Cientistas solicitam plano de contingência contra possíveis “ataques” da IA

Possível perda de controle da tecnologia sem um plano de prevenção preocupa cientistas; reunião discutiu protocolos globais em caso de danos catastróficos

Cientistas responsáveis por ajudar a desenvolver sistemas de Inteligência Artificial (IA) alertaram os países para criarem um sistema global de supervisão para evitar e proteger de riscos graves reproduzidos pela nova tecnologia que está em rápido desenvolvimento. Na segunda-feira (16), um grupo de cientistas emitiu comunicado expressando grande preocupação em relação à tecnologia que ajudaram a criar, pois ela pode causar sérios danos em várias áreas.

Com o lançamento do ChatGPT e outros sistemas de inteligência artificial, textos e imagens são criados com apenas alguns comandos, mostrando como a nova tecnologia tem avançando solidamente rápido. Com a pressa de comercializar a AI em todos os formatos, a ciência a aperfeiçoou para que o sistema fosse integrado a smartphones, carros e até mesmo em salas de aula. Esta última forçou governos a regulamentar o novo sistema para ter maior aproveitamento educacional.

Cientistas em alerta

Segundo os cientistas, a Inteligência Artificial pode ultrapassar a capacidade de seus criadores em questão de anos. “A perda de controle humano ou o uso malicioso desses sistemas de IA poderia levar a resultados catastróficos para toda a humanidade.”

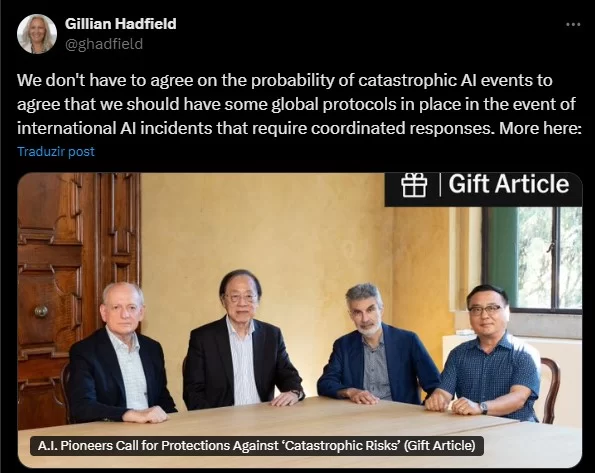

Gillian Hadfield, professora de ciência da computação e governo na Universidade Johns Hopkins, disse que se hoje os sistemas de inteligência artificial desenvolvessem habilidades capazes de superar os humanos, não teríamos um plano para controlá-los.

Postagem de Gillian Hadfield sobre o encontro Diálogos Internacionais sobre Segurança da IA (Foto:Reprodução/@ghadfield/ X)

Plano de controle de IA

Nos dias 5 a 8 deste mês, a professora juntamente com cientistas do mundo todo se reuniram em Veneza, Itália, a fim de discutir planos de prevenção. Organizada pelo Safe AI Forum, a terceira reunião dos Diálogos Internacionais sobre Segurança da IA foi realizada por um grupo de pesquisa sem fins lucrativos dos Estados Unidos chamado Far.AI.

A proposta do grupo é de que países criem autoridades de segurança da IA para registrar sistemas de inteligência artificial dentro de suas fronteiras. Segundo os cientistas, as autoridades trabalhariam juntas para poderem concordar com um conjunto de linhas vermelhas e sinais de alerta, recurso para detectar possíveis manobras das inteligências artificiais para tentar copiar ou enganar seus criadores de forma intencional. O comunicado foi assinado por cientistas de diversas regiões como: China, Reino Unido, Cingapura, Estados Unidos, e Canadá.

Foto destaque: Sistema de Inteligência Artificial (Reprodução: Jason Marz/Getty Imagens Embed)